Ars Teknik

Aceleden ayrılmamak üretici yapay zekayı entegre edin aramaya başladı, Çarşamba günü DuckDuckGo duyuruldu Ördek Yardımı, Anthropic ve OpenAI teknolojisiyle desteklenen yapay zeka destekli olgusal özet hizmeti. DuckDuckGo’nun tarayıcı uzantıları ve göz atma uygulamalarının kullanıcıları için geniş bir beta testi olarak bugün ücretsiz olarak sunuluyor. Bir AI modeli tarafından desteklenen şirket, DuckAssist’in bir şeyler uydurabileceğini kabul ediyor ancak bunun nadiren olmasını umuyor.

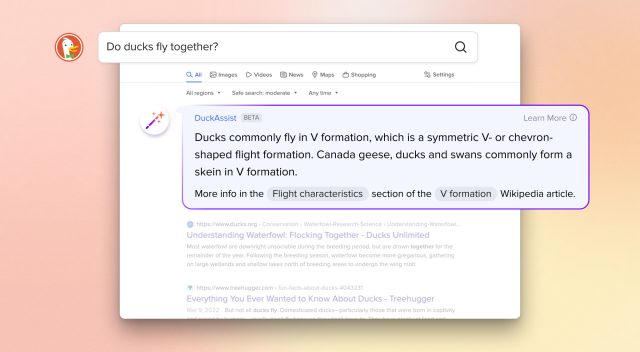

Şu şekilde çalışır: Bir DuckDuckGo kullanıcısı Wikipedia tarafından yanıtlanabilecek bir soru ararsa, DuckAssist görünebilir ve aşağıda listelenen kaynak bağlantıları ile Wikipedia’da bulduklarının kısa bir özetini oluşturmak için yapay zeka doğal dil teknolojisini kullanabilir. Özet, DuckDuckGo’nun normal arama sonuçlarının üzerinde özel bir kutuda görünür.

Şirket, DuckAssist’i yeni bir “Anında Yanıt” biçimi olarak konumlandırıyor; bu, kullanıcıların haberler, haritalar ve hava durumu gibi konularda hızlı bilgi bulmak için web arama sonuçlarında gezinmesini engelleyen bir özellik. Bunun yerine arama motoru, Anında Yanıt sonuçlarını normal web sitesi listesinin üzerinde sunar.

ÖrdekÖrdek Git

DuckDuckGo, DuckAssist’i oluşturmak için hangi büyük dil modelini (LLM) veya modelleri kullandığını söylemez. OpenAI API’si muhtemel görünüyor. Ars Technica, açıklama için DuckDuckGo temsilcilerine ulaştı. Ancak DuckDuckGo CEO’su Gabriel Weinberg, kaynak kullanımını nasıl kullandığını açıklıyor. şirket blog yazısı:

DuckAssist, DuckDuckGo’nun aktif indekslemesini kullanarak belirli bir kaynak kümesini (şimdilik bu genellikle Wikipedia ve ara sıra Britannica gibi ilgili siteler) tarayarak soruları yanıtlar. Vikipedi’de bulduklarımızı özetlemek için OpenAI ve Anthropic’in doğal dil teknolojisini kullandığımız için, bu yanıtlar asıl sorunuza geleneksel arama sonuçlarından veya diğer Hızlı Yanıtlardan daha doğrudan yanıt vermelidir.

DuckDuckGo’nun ana satış noktası gizlilik olduğu için şirket, DuckAssist’in “anonim” olduğunu söylüyor ve arama veya tarama geçmişini kimseyle paylaşmadığını vurguluyor. Weinberg, “Ayrıca, arama ve göz atma geçmişinizi arama içeriği ortaklarımıza anonim olarak tutuyoruz,” diye yazıyor Weinberg, “bu durumda, tanımladığımız Wikipedia cümlelerini özetlemek için kullanılan OpenAI ve Anthropic.”

DuckDuckGo, OpenAI’nin GPT-3 veya ChatGPT API’sini kullanıyorsa, site her çağrıldığında potansiyel olarak her kullanıcının sorgusunu OpenAI’ye gönderebileceğinden endişe edilebilir. Ancak satır aralarını okuyunca, özetlemek için kullanıcının aramasının değil, yalnızca Wikipedia makalesinin (veya bir makaleden alıntının) OpenAI’ye gönderildiği görülüyor. Bu noktada da açıklama için DuckDuckGo’ya ulaştık.

DuckDuckGo, DuckAssist’i “önümüzdeki aylarda kullanıma sunmayı umduğumuz bir dizi üretken yapay zeka destekli özelliğin ilki” olarak adlandırıyor. Fırlatma iyi giderse ve kimse düşman istemleriyle kırar—DuckDuckGo, özelliği “önümüzdeki haftalarda” tüm arama kullanıcılarına sunmayı planlıyor.

DuckDuckGo: Halüsinasyon riski “büyük ölçüde azaldı”

sahip olduğumuz gibi daha önce kapsanan Ars’ta LLM’ler, AI araştırmacılarının “halüsinasyonlar” olarak adlandırdıkları inandırıcı hatalı sonuçlar üretme eğilimindedir. sanat terimi AI alanında. Referans verilen materyali bilmiyorsanız halüsinasyonları tespit etmek zor olabilir ve bunlar kısmen OpenAI’nin GPT tarzı LLM’lerinin veri setlerinde gerçek ve kurgu arasında ayrım yapmamasından kaynaklanır. Ek olarak, modeller, normalde doğru olan verilere dayanarak yanlış çıkarımlar yapabilir.

Bu noktada DuckDuckGo, kaynak olarak Wikipedia’ya büyük ölçüde güvenerek halüsinasyonlardan kaçınmayı umuyor: “DuckAssist’ten yalnızca Wikipedia ve ilgili kaynaklardan gelen bilgileri özetlemesini isteyerek”, Weinberg yazar“Halüsinasyon görme” – yani sadece bir şeyler uydurma – olasılığı büyük ölçüde azalır.”

Kaliteli bir bilgi kaynağına güvenmek, yapay zekanın veri kümesindeki yanlış bilgilerden kaynaklanan hataları azaltabilirken, yanlış çıkarımları azaltmayabilir. Ve DuckDuckGo, yapay zeka tarafından oluşturulan sonucun altında doğruluğunu incelemek için kullanılabilecek bir kaynak bağlantısı sağlayarak, doğrulama yükünü kullanıcıya yükler. Ancak mükemmel olmayacak ve CEO Weinberg bunu kabul ediyor: “Yine de DuckAssist her zaman doğru yanıtlar üretmeyecek. Hata yapmasını kesinlikle bekliyoruz.”

Daha fazla firma kolayca yanlış bilgi verebilen LLM teknolojisini kullandıkça, şirketlerin ve müşterilerin insanları gerçeklere dayalı olarak bilgilendirmek için tasarlanmış yapay zeka destekli bir üründe hangi düzeyde halüsinasyonun tolere edilebilir olduğuna karar vermesi biraz zaman alabilir ve yaygın kullanım alabilir.